Nghiên cứu nội bộ về Claude: Hiểu cách xử lý thông tin của mô hình ngôn ngữ lớn

Nghiên cứu mới đây của Anthropic khám phá chi tiết cách mô hình ngôn ngữ lớn như Claude quyết định khi nào nên giữ im lặng và khi nào đưa ra phản hồi.

Vấn đề thường gặp với mô hình ngôn ngữ lớn (LLM) là khả năng tự chế nội dung, hay còn gọi là hiện tượng "ảo giác" thông tin. Nhiều người thắc mắc tại sao những mô hình này không đơn giản thừa nhận "không biết" thay vì tự tạo ra những câu trả lời nghe có vẻ hợp lý nhưng vô căn cứ.

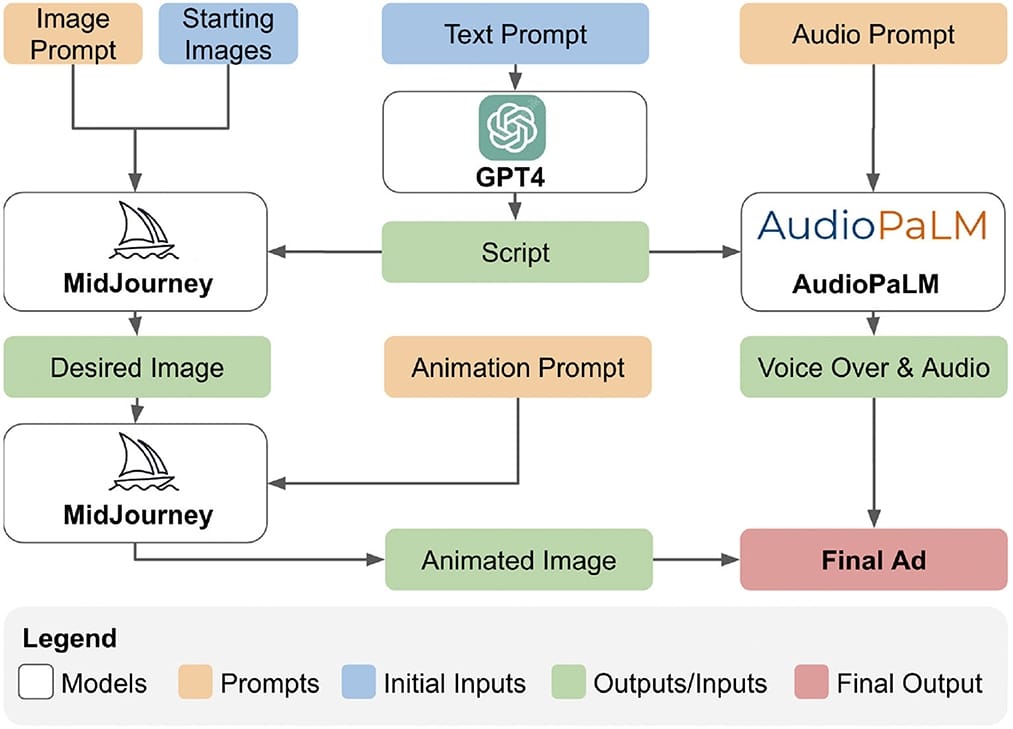

Nhờ nghiên cứu từ Anthropic, chúng ta bắt đầu có cái nhìn sâu sắc hơn về "mạch điện tử" bên trong giúp một LLM đưa ra quyết định khi nào nên phản hồi một câu hỏi, thậm chí khi có thể không chính xác. Qua các nghiên cứu gần đây, quy trình "nhận thức" của LLM như Claude đang dần được hiểu sâu hơn, mở ra cơ hội giảm thiểu tình trạng "ảo giác" thông tin.

Anthropic đã tiết lộ rằng khi một từ vựng không quen thuộc hiện diện trong mô hình, Claude có xu hướng kích hoạt một mạch nằm trong tình trạng "không thể trả lời". Mạch này thường mặc định ở trạng thái "bật" trong phiên bản mô hình được tinh chỉnh, khiến Claude miễn cưỡng trả lời nếu không có những thông tin đủ mạnh trong cơ sở dữ liệu.

Qua các thử nghiệm, các nhà nghiên cứu cũng khám phá cách mô hình có thể bị "lừa" để tạo ra thông tin không tồn tại, ví dụ như "Michael Batkin", nếu một số tính năng neuron được tăng cường không đúng cách. Chuyện này cho thấy "ảo giác" có thể liên quan đến việc kích hoạt nhầm chức năng "thực thể đã biết".

Mặc dù vậy, quy trình hiểu biết của Claude vẫn chưa đủ chính xác để phân biệt rõ ràng giữa những gì nó biết và không biết. Ví dụ, khi hỏi về một bài báo tưởng tượng của nhà nghiên cứu AI Andrej Karpathy, mô hình đưa ra một tựa đề nghe hợp lý nhưng không có thực.

Việc nắm bắt quy trình nội bộ của Claude không chỉ giúp hiểu rõ hơn về cách thức trả lời của mô hình mà còn hứa hẹn mở ra hướng nghiên cứu sâu hơn về vấn đề ảo giác thông tin trong tương lai. Hy vọng rằng đây chỉ là bước đầu tiên đi tới những giải pháp mạnh mẽ hơn để cải thiện độ tin cậy của các mô hình ngôn ngữ này.